Etik Bir Sorun Olarak Ölü İnternet Teorisi

1. Özet

Ölü İnternet teorisi, internetteki etkileşimlerin büyük bir bölümünün insanlar yerine otonom botlar tarafından oluşturulduğunu savunur. Bu çalışma, sentetik içeriklerin ve sahte etkileşimlerin algoritmik manipülasyonlar aracılığıyla kamuoyu algısını nasıl yönlendirdiğini incelemektedir. İnsanların otonom yazılımlarla etkileşime girerek manipüle edilmesi; özerklik, güven ve şeffaflık ilkelerini temelden sarsmaktadır. Bu soruna çözüm olarak sunulan “Dijital Gerçeklik Doğrulama Sistemi (DGDS)”, sorunun sadece felsefi değil teknik bir yaklaşımla çözülebileceğini savunmaktadır. Çalışmada, DGDS’nin temelini oluşturan ağ trafiği analizi, paket izleme (packet sniffing) ve protokol anormalliklerinin tespiti gibi teknik yöntemler detaylandırılarak, internetin organik yapısını korumaya yönelik uygulamalı bir model sunulmaktadır.

İçindekiler

-

Özet

-

Ölü İnternet Teorisi Nedir?

-

Teorinin Ortaya Çıkışı ve Güncel Bulgular

-

Etkileşim Manipülasyonunun Etik ve Toplumsal Zararları

-

5.1. Sahte Çoğunluk İllüzyonu (Astroturfing)

-

5.2. Model Çöküşü (Model Collapse)

-

5.3. Anlamsal Daralma

-

-

Bireysel Savunma: Dijital Medya Okuryazarlığı

-

Teknik Çözüm: Dijital Gerçeklik Doğrulama Sistemi (DGDS) ve Ağ Analizi

-

Derste Yapılacak Örnek Uygulama: Ağdaki Hayaletler (Turing Testi)

-

Sonuç

-

Kaynakça

-

Özgünlük ve Yapay Zeka Kontrol Raporları

2. Ölü İnternet Teorisi Nedir?

İnternet -ve devamında sosyal medya- başlangıçta insanların bilgi paylaştığı, tartıştığı ve organik bağlar kurduğu eşler arası (peer-to-peer) bir ağ olarak tasarlanmıştır. Ancak günümüzde bu yapının yerini, büyük ölçüde makinelerin birbiriyle iletişim kurduğu sentetik bir ağın aldığı iddia edilmektedir. En temel tanımıyla ölü internet teorisi; web trafiğinin, içerik üretiminin ve sosyal medya etkileşimlerinin ezici bir çoğunluğunun gerçek insanlar tarafından değil, botlar ve yapay zeka algoritmaları tarafından yönlendirildiğini savunan bir yaklaşımdır (Toplumsal Araştırmalar Merkezi, 2024). Bu teori, dijital iletişimde gerçekliğin kaybolduğunu, botlar aracılığıyla sahte bir gerçeklik ve görüş kalabalığı yaratıp internetin ve sosyal medyanın dil ve üslubunu değiştirerek; yönetenlerin, insanları da kendi yönettikleri sürüye katmayı amaçladığını ve bu yolla, ağın sadece insanları manipüle etmek üzere kodlanmış bir yankı odasına dönüştüğünü öne sürer.

3. Teorinin Ortaya Çıkışı ve Güncel Bulgular

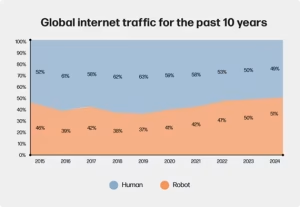

Ölü İnternet Teorisi, ilk olarak 2010’ların sonlarında çeşitli forumlarda kullanıcıların “herkesin aynı şeyleri tekrar ettiği” yönündeki gözlemleriyle kavramsal olarak tartışılmaya başlanmıştır (İldiz, 2026). Başlangıçta bir komplo teorisi olarak değerlendirilse de siber güvenlik ve ağ analizi firmalarının raporları bu durumun teknik bir gerçeklik olduğunu kanıtlamıştır. Imperva (2024) tarafından yayınlanan güncel verilere göre, küresel web trafiğinin %52’sinden fazlası otomatikleştirilmiş bot trafiğinden oluşmaktadır.

Bunun en çarpıcı örnekleri sosyal medya platformlarındaki “etkileşim yemi” (engagement bait) vakalarıdır. Yapay zeka üretimi, gerçeküstü veya absürt bir görselin altına, yine bot hesaplar saniyeler içinde binlerce basmakalıp yorum atmakta ve bu sahte etkileşim döngüsü, platformun kendi algoritması tarafından ödüllendirilerek organik kullanıcılara dayatılmaktadır. Bu durumla sistem, insan kullanıcıları tamamen sistemin dışında bırakmaktadır. Dolayısıyla sistem, algoritmaların algoritmaları beğendiği otonom bir simülasyon yaratmaktadır (Yılmaz & Kaan, 2024).

4. Etkileşim Manipülasyonunun Etik ve Toplumsal Zararları

Ölü İnternet gerçeği, insanların dijital ortama duyduğu güveni derinden sarsmıştır. Dolayısıyla bireyler karşılarında iletişim kurdukları “kişinin” bir insan olup olmadığını seçememektedir. Dolayısıyla bu durum bilişim etiği açısından şu majör zararlara yol açmaktadır:

4.1. Sahte Çoğunluk İllüzyonu (Astroturfing)

Otonom bot ağları kullanılarak, toplumda karşılığı olmayan marjinal bir fikir veya yalan haber, milyonlarca insan tarafından destekleniyormuş gibi gösterilebilir. Bu manipülasyon, demokratik süreçleri ve kamuoyu algısını doğrudan tehdit eder..

4.2. Model Çöküşü (Model Collapse)

Ağ üzerindeki verilerin kalitesinin bozulması, teknolojik gelişimi de baltalamaktadır. Büyük dil modelleri, insanlarınki yerine interneti dolduran botların sentetik verileriyle eğitiliyor. Dolayısıyla algoritmaların çıktı kalitesi geri döndürülemez şekilde bozuluyor.

4.3. Anlamsal Daralma

İnternetteki içeriklerin otonomlaşması, insan iletişimindeki doğal kusurları, mizahı ve karmaşıklığı yok etmektedir. Dolayısıyla tek tip, samimiyetsiz ve yapay bir dil hakim olmaktadır.

5. Bireysel Savunma: Dijital Medya Okuryazarlığı

Sosyal medyada, hem bot trafiği hem de botlar tarafından kışkırtılan veya manipüle edilen insan trafiğini görmek mümkün. Dolayısıyla bireylerin bu sentetik ağ içinde manipüle edilmekten korunmasının ilk adımı dijital şüpheciliktir. Çünkü internet kullanıcılarının, özellikle duyguları aşırı uçlarda tetiklemeyi (öfke, aşırı neşe, kutuplaşma) hedefleyen içeriklerin, etkileşim maksimizasyonu için kodlanmış otonom ajanlar olduğunu kavraması gerekir (Çelik, 2024). Gerçek insan iletişimi nüanslar içerirken, bot iletişimleri belirli anahtar kelimeler ve hedef odaklı komutlar etrafında şekillenir. Ancak bu ayrımı yapmak için gelişmiş bir medya ve yapay zeka okuryazarlığı gerekir.

6. Teknik Çözüm: Dijital Gerçeklik Doğrulama Sistemi (DGDS) ve Ağ Analizi

Bilişim etiği krizlerinde sadece felsefi tartışmalarla değil, teknik altyapı mekanizmalarıyla çözülebilir. Bu bağlamda önerilen “Dijital Gerçeklik Doğrulama Sistemi (DGDS)”, sentetik-organik trafikten ayırımını bir ağ güvenliği ve analiz mimarisidir. DGDS’nin merkezinde sistem yönetimi ve paket analizi yatar.

Gerçek kullanıcının ağdaki davranışıyla otonom script’in davranışı, taşıma (Transport) ve uygulama (Application) katmanlarında tamamen farklıdır. Ayrıca insanlar bir web sayfasına erişirken asenkron fare hareketleri yapar. Sayfa yükleme süreleri arasında düzensiz boşluklar bırakır. Ancak otonom bir bot, milisaniyelik periyotlarla senkronize HTTP/HTTPS istekleri gönderir. Ve DGDS, Python programlama dili ve ağ analizi kütüphaneleri (örneğin Scapy) ile geliştirilmiş paket izleyici (packet sniffer) modüller kullanarak ağ üzerindeki protokol başlıklarını (header) dinamik olarak inceler. Gelen veri paketlerinin boyutları, istek sıklıkları ve “User-Agent” anomalileri filtrelenerek bot trafiğini tespit eder.

DGDS’nin ikinci aşaması ise “İçerik Kaynağı Etiketleme”dir. Ağ analizini geçebilen gelişmiş yapay zeka içerikleri, dijital filigranlarla etiketlenmeli ve bu süreci bağımsız siber güvenlik kurumları denetlemelidir.

7. Örnek Uygulama: Ağdaki Hayaletler (Turing Testi)

Makalenin sunumu sırasında dinleyicilerin konuyu uygulamalı olarak deneyimleyebilmesi için “Turing Testi: Ağdaki Hayaletler” isimli interaktif bir etkinlik tasarlanmıştır. Uygulamanın adımları şu şekildedir:

-

İçerik Yansıtma: Sınıf ekranına önceden hazırlanmış sosyal medya içerikleri yansıtılır. Bu içeriklerin bir kısmı gerçek insanlara, bir kısmı ise yapay zeka botlarına aittir.

-

Oylama Aşaması: Sınıftaki öğrenciler telefonları aracılığıyla Quizizz uygulamasına girerek ekrandaki içerik için “Bot mu, İnsan mı?” sorusunu oylar.

-

Analiz ve Tartışma: Oylama sonuçları ekranda gösterilir. Sınıfın sentetik içerikleri ayırt etme veya edememe durumuna göre, bu durumun DGDS (Dijital Gerçeklik Doğrulama Sistemi) ihtiyacını ne kadar haklı çıkardığı tartışılarak uygulama sonlandırılır.

Şekil 1. Son 10 yıldaki küresel internet trafiği

Kaynak: Imperva (2023).

8. Sonuç

Sonuç olarak teori, dijital etkileşimlerin doğallığını kaybetmesiyle sonuçlanan teknik ve etik bir gerçekliğe dönüşmüştür. Bot ağlarının web trafiğini domine etmesi, bireyleri otonom yazılımların manipülasyonuna açık hale getirmektedir. Dolayısıyla bu sorunun üstesinden gelmek için bireysel düzeyde dijital okuryazarlığın artırılması şarttır. Ancak nihai çözüm; ağ trafiği analizi, anormallik tespiti ve algoritmik şeffaflığı merkeze almalıdır. Dijital Gerçeklik Doğrulama Sistemi (DGDS) gibi teknik müdahaleler standart haline getirilmelidir. Zira internetin yeniden insan merkezli bir iletişim alanı olabilmesi buna bağlıdır.

9. Kaynakça

Arğın, E. (2025). Yapay zekâ ve algı yönetimi: Algoritmalar, manipülasyon ve toplumsal güven. İnsanat Sanat Tasarım ve Mimarlık Araştırmaları Dergisi, 5(2), 1023-1042. https://dergipark.org.tr/tr/pub/insanat/article/1832337

Aydemir, A., Gökçe, M., & Kaya, M. (2024). Yapay zekâ ve dezenformasyon: OpenAI raporu doğrultusunda küresel dezenformasyon kampanyalarının analizi. TRT Akademi, 10(23), 208-237. https://dergipark.org.tr/tr/pub/trta/issue/87771/1562358

Çelebi, C., & Demir, U. (2023). Yapay zekâ okuryazarlığı konulu çalışmaların sistematik derleme yöntemiyle incelenmesi. Necmettin Erbakan Üniversitesi Ereğli Eğitim Fakültesi Dergisi, 5(2), 535-560. https://dergipark.org.tr/tr/pub/neueefd/article/1389126

Imperva. (2024). 2024 bad bot report: The state of automated traffic. Imperva Cybersecurity Research. https://www.imperva.com/resources/resource-library/reports/2024-bad-bot-report/

Öğüç, Ç. (2025). Ölü internet hipotezi: Yapay zeka, sansür ve insan merkezli dijital söylemin çöküşü. İmgelem, Yeni Medya Çalışmaları, 751-776. https://dergipark.org.tr/en/pub/imgelem/article/1650961

10. Özgünlük ve Yapay Zeka Kontrol Raporları

Bu makalenin özgünlük (intihal) denetimi 13 Mayıs 2026 tarihinde PlagiarismDetector.net sistemi üzerinden gerçekleştirilmiştir

2% Plagiarism – 98% Unique

Makalenin yapay zeka metin üretim kontrolü ise 13 Mayıs 2026 tarihinde Originality.AI aracı üzerinden yaptırılmıştır.

Yapay zeka tespit oranı : 8%

Bu eser Umut Uzundal tarafından hazırlanmış olup, Creative Commons Atıf-AynıLisanslaPaylaş 4.0 Uluslararası Lisansı ile lisanslanmıştır.

Ben Marmara Üniversitesi Bilgisayar ve Öğretim Teknolojileri Eğitimi Bölümü’nde dördüncü sınıf öğrencisiyim. Eğitimim boyunca farklı yazılım dilleriyle çalışarak güçlü bir teknik temel edindim ve hızlı öğrenme becerisi geliştirdim. Bilgisayar ağları ve sistem yönetimi başlıca ilgi alanlarım olup, web geliştirme ve algoritma tasarımında da aktif projeler yürütüyorum. Ekim 2022 ile Kasım 2023 arasında Trendyol Express’te yarı zamanlı kargo sortaj elemanı olarak çalıştım. Bu süreçte kargoların doğru şekilde ayrıştırılması, hatalı yönlendirmelerin raporlanması ve operasyonel düzenin sağlanmasına katkı sundum. PHP, JavaScript, Python, C ve HTML/CSS konularında deneyimliyim; algoritma tasarımı ve Microsoft Office araçlarını etkin kullanırım. SQL, Dart, Windows Server ve Wireshark alanlarında temel bilgiye sahibim. Cisco Packet Tracer ile ağ simülasyonları gerçekleştirdim. Türkçe ana dilim, İngilizceyi akıcı kullanırım. Sorumluluk alan, analitik düşünen ve ekip çalışmasına uyumlu biriyim. Kariyerimde sürekli gelişim hedefler, yenilikçi çözümler üretmeyi amaçlarım. Organizasyonlara değer katacak sürdürülebilir projelerde yer almak istiyorum. Bu doğrultuda yeni teknolojileri takip eder, kendimi sürekli günceller ve değişen ihtiyaçlara hızlı uyum sağlarım. Etkin iletişim kurar, sonuç odaklı çalışırım ve disiplinliyim.