Eğitsel Yapay Zeka (AI-ED) Sistemlerinde Algoritmik Şeffaflık ve Öğrenci Özerkliği: Karar Mekanizmalarının Etik Denetimi

Beyza Naz Kavuş

Bilgisayar ve Öğretim Teknolojileri Eğitimi, Marmara Üniversitesi

İçerik

1. Özet

2. Giriş

3. Eğitsel Yapay Zeka Algoritmalarının Karar Alma Süreçleri

4. Algoritmik Paternalizm

5. Öğrenci Otonomisi

6. Algoritmaların Görünmez İşleyişi (Kara Kutu)

7. Şeffaflık ve Güven Dengesi

8. Mevcut Dijital Öğrenme Ortamlarında Eğitsel Yapay Zeka Kullanımı

8.1. Duolingo ve Birdbrain Algoritması

8.2. ALEKS ve Algoritmik Paternalizm

9. Etik Bildirim Ve Onay Modeli

10. Uygulama Süreci

10.1. Kullanıcı Etkileşimi ve Veri Toplama Süreci

10.2. Karar Analiz Mekanizması

10.3. Şeffaflık Etiketi Sistemi

10.4. Özerklik Kontrol Mekanizması

10.5. Alternatif Öğrenme Yolunun Oluşturulması

10.6. Web Tabanlı Erişim ve Sınıf İçi Kullanım

10.7. Teknik ve Etik Tasarım Yaklaşımı

11. Sonuç

12. Kaynakça

13. Özgünlük Raporu

14. Yapay Zeka Kontrol Raporu

1. Özet

Eğitimsel yapay zeka sistemleri, kişiselleştirilmiş öğrenme deneyimleri sunma konusunda büyük bir potansiyele sahip olsa da, bu sistemlerin karar alma süreçleri kullanıcılardan gizlenmektedir, bu da “kara kutu” sorununa ve “algoritmik paternalizm” riskine yol açmaktadır. İncelendiğinde, buradaki sistemin öğrenci adına kararlar aldığı ancak bu kararların gerekçelerini sunmadığı, bunun sonucunda da öğrenci otonomisinin zayıfladığı görülmektedir.

Bu çalışma, ilgili etik problem için çözüm olarak geliştirilen “Etik Bildirim ve Onay Modeli”ni sunmaktadır. Model, XAI (Açıklanabilir Yapay Zekâ: Explainable Artificial Intelligence) prensiplerine dayanan iki aşamalı bir yapı önermektedir. İlk aşamada, yapay zekânın yönlendirmeleri somut verilerle açıklanmaktadır. Bu açıklamalar, öğrenciye “şeffaflık etiketleri” aracılığıyla sunulmaktadır. İkinci aşamada ise geliştirilen “özerklik kontrol mekanizması” devreye girmektedir. Bu mekanizma, öğrenciye sistem kararlarına itiraz etme hakkı vermektedir. Ayrıca öğrenciye alternatif öğrenme yollarını seçme imkânı da sunmaktadır.Model, literatürde yer alan güven ve şeffaflık dengesiyle benzer özellikler taşımaktadır. Sistem odaklı karar verme yapısının dönüşmesi hedeflenmektedir. Böylece yapay zekânın bir “otorite” olarak konumlanmasının önüne geçilmektedir. Bunun yerine, kararlarını açıklayan ve öğrenciyle karşılıklı etkileşim kuran şeffaf bir “asistan” rolü önerilmektedir.

Bu dönüşüm, öğrencinin pasif bir öğrenici olarak kalmasını engellemeyi amaçlamaktadır. Model, öğrencinin kendi kararlarını bilinçli biçimde takip eden ve uygulayan aktif bir öğrenici konumuna güçlenmesini hedeflemektedir.

Anahtar Kelimeler: Eğitsel Yapay Zeka, Etik Bildirim, Algoritmik Şeffaflık, Öğrenci Otonomisi, Açıklanabilir Yapay Zeka (XAI).

2. Giriş

Günümüzde yapay zeka yardımıyla eğitim programları, her öğrenci için bireysel ihtiyaçlarına göre uyarlanmış özel bir ders programı oluşturabilir. Bu sistemler, bir öğrencinin öğrenme hızı ve performans düzeyi gibi bilgileri analiz ederek, hangi konuların hangi zorluk seviyesinde öğrenilmesi gerektiğini belirler. Ancak süreç içerisinde yapay zeka, öğrenci hakkında önemli kararlar alırken kararlarının mantığını kullanıcıyla paylaşmaz. Öğrenci, neden belirli bir seviyede tutulduğunu, önüne neden belirli içeriklerin konduğunu bile bilmeden sistemi takip etmek zorunda kalmaktadır.

Bu durum, yapay zekanın destekleyici rolünü aşarak, eğitim sürecinde öğrencinin yolculuğunu tek başına yönlendiren kapalı bir sisteme dönüşmesine neden olur. Kararların açıklanmaması, öğrencinin kendi öğrenme süreci üzerindeki onay hakkını elinden alır. Bu yazı, eğitimin tüm aşamalarında yapay zekanın kullanılacağı bir ortamda eğitime yön veren yapay zeka kararlarının nasıl şeffaf hale getirilebileceğini ve öğrencinin bu sürece nasıl taraf olabileceğini incelemektedir. Temel hedef, teknolojinin öğrenciyi yönettiği değil, öğrencinin teknolojiye yön verdiği bir durumun gerekli olduğu argümanını ortaya koymaktır.

3. Eğitsel Yapay Zeka Algoritmalarının Karar Alma Süreçleri

Eğitsel yapay zekâ sistemlerinin temelinde, her öğrenciyi temsil eden bir “Öğrenci Modeli” bulunmaktadır. Bu model, öğrencinin tüm dijital etkileşimlerini işlemektedir. Sistem yalnızca doğru ve yanlış cevaplara ilişkin veri toplamaz. Aynı zamanda “tıklama akışı”, görevde geçirilen süre ve öğrenme materyalleriyle etkileşim sıklığı gibi verileri de analiz eder. Bu veriler daha sonra Bilgi İzleme algoritmaları tarafından işlenmektedir. UNESCO’nun 2021 raporunda belirtildiği gibi bu algoritmalar, öğrencinin bir konu hakkındaki bilgi düzeyine ilişkin olasılıksal tahminler üretmektedir. Teknik açıdan bakıldığında bu süreç, öğrencinin bilgi durumunu sürekli güncelleyen matematiksel modellerle desteklenmektedir. Böylece sistem, öğrencinin bir sonraki içeriğe hazır olup olmadığını tahmin eden dinamik bir veri profili oluşturmaktadır.

Toplanan veriler daha sonra sistemin karar verme birimine aktarılmaktadır. Bu birim, öğrenci modelinden elde edilen verileri pedagojik kurallarla karşılaştırmaktadır. Bazı durumlarda ise makine öğrenmesi modellerinden yararlanılmaktadır. Öğrencinin hata yapma eğilimi belirli bir eşiği aşarsa sistem “başarısızlık olasılığı” kararı üretmektedir. Ardından gelişmiş içeriklere erişim otomatik olarak sınırlandırılmaktadır. Bu aşamada sistem, öğrenciye sunulacak içerikleri olasılık hesaplamalarına göre belirlemektedir. Böylece öğrenci “kişiselleştirilmiş” bir öğrenme yoluna yönlendirilmektedir. Teknik olarak bu yapı bir “öneri sistemi” gibi çalışmaktadır. Ancak eğitim bağlamında bu durum, öğrencinin akademik ilerlemesini doğrudan yönlendiren bir müdahaleye dönüşmektedir. Bu nedenle sistem, klasik öneri sistemlerinden farklılaşmaktadır.

Arayüz, kararların hangi parametrelere dayandığını açıklamadığı sürece önemli bir sorun ortaya çıkmaktadır. Ayrıca parametrelerin hangi ağırlıklarla değerlendirildiği de öğrenciye gösterilmemektedir. Bu durum, algoritmanın öğrenci üzerinde denetlenemeyen bir otorite kurmasına neden olabilmektedir.

4. Algoritmik Paternalizm

Algoritmik paternalizm, söz konusu sistemin kullanıcının tercihlerini hiçe sayarak ne onun için “en doğru” karar olduğunu hesaplaması, ve bu kararı bir otorite olarak kullanıcıya dayatmasıdır (Yeung, 2017). Eğitim yazılımları bağlamında bu durum, yapay zekanın öğrenciyi bir veri profili olarak değerlendirmesi ve onun “iyiliği için” öğrenme yolunu tek taraflı olarak dikte etmesi şeklinde tezahür eder. Öğrencinin geçmişte düşük performans sergilemiş olması dikkate alınarak, sistem “bu öğrenci ileri seviye konuları öğrenemez” tahminini yapabilir ve sıkıntılı materyali onunla paylaşmama kararı alabilir . Buradaki etik mesele, yapay zekanın pedagojik bir destek aracı olma özelliğini kaybederek öğrenciye karşı denetlenemeyen vasis ya da koruyucu bir rol üstlenmesi olarak görülür (UNESCO, 2021). Bu koruyucu tavır, öğrencinin başarısız olmasını önlemeye çalışırken kendi sınırlarını deneyimlemesinin de önüne geçmektedir. Dolayısıyla paternalizm, algoritmanın öğrencinin akademik kaderini gizli bir şekilde belirlemesi ve kararını şeffaf olmayan bir yöntemle uygulamasıdır.

5. Öğrenci Otonomisi

Öğrenci otonomisi öğrenenin öz öğrenme süreci üzerinde kontrolü olması, kendi öğrenme hedeflerini belirleyebilmesi ve hata yapma özgürlük alanına sahip olmasıdır. Yapay zeka sistemleri, “en verimli yol” önerileri ile öğrenciyi gizlice belirli tercihlere doğru yönlendirerek bu bağımsızlığı sarsabilir (Yeung, 2017).Yapay zeka sistemleri, kişiselleştirme vaadiyle öğrenciyi sürekli belirli bir yöne doğru “dürtmekte” (nudging), ve bu durumda bireyin bağımsız karar alma mekanizmaları zayıflamaktadır. Gerçek bir özerklik seçeneklerden birini seçmek değildir, sunduğu opsiyonun arkasındaki mekanizmayı anlamak ve bu yönlendirmeyi kabul etmeme hakkına sahip olmaktır (UNESCO, 2021). Öğrenenlerin kendi öğrenme stratejilerini geliştirebilecekleri alan daralmakta ve öğrenenlerin bu algoritmanın öngörülerine bağımlı hale geldiği görülmektedir. Eğitimde özerklik teknolojinin birey üzerine dayatılması değil, teknoloji ile kendi gelişim hedefleri doğrultusunda bir aracı olarak ilişki kurabilmesidir. Bu bağlamda otonomi, teknolojinin öğrenciye ne yapacağını söylemesi değil, öğrencinin teknoloji üzerinde kendi hedefleri doğrultusunda kontrolü sağlayacak bilinçte ve güçte olmasıdır.

6. Algoritmaların Görünmez İşleyişi (Kara Kutu)

Yapay zeka sistemleri, karmaşık veri setlerini işleyerek bir sonuç üretir ancak bu sonuca hangi kriterlerle ulaştığını kullanıcıya açıklayamaz. Sistemin girdi ve çıktıları görünürken, aradaki karar verme sürecinin gizli kalması “kara kutu” (black box) problemi olarak tanımlanır (Adadi ve Berrada, 2018). Eğitimde bu kapalılık, öğrencinin neden belirli bir konuya yönlendirildiğini anlayamamasına ve dolayısıyla sistemi sorgulayamamasına neden olur.

7. Şeffaflık ve Güven Dengesi

Adil ve anlamlı kararların verilmesi, güvene dayalı bir öğrenme ortamının oluşması için gereklidir. Ancak opak bir algoritma yaptığı hataları ya da sahip olduğu önyargıları saklayabilir. Eğer öğrenci sistemin mantığını kavrayamıyor ise, ona tam olarak güvenmesi de beklenemez. Bu noktada şeffaflık teknik bir özellik değil öğrencinin sistemle sağlıklı iletişim kurabilmesi için temel bir gerekliliktir. Açık ve şeffaf eğitim teknolojileri, kullanıcı dostu bir dilde algoritmanın “neden” bu kararı verdiğini kullanıcıya açıklamasıyla sağlanabilir.

8. Mevcut Dijital Öğrenme Ortamlarında Eğitsel Yapay Zeka Kullanımı

Günümüzde popüler olan birçok öğrenme platformu, öğrenciyi yönlendirmek için gelişmiş algoritmalar kullanmaktadır. Ancak bu sistemler incelendiğinde, şeffaflık ve öğrenci otonomisi açısından ciddi eksiklikler barındırdıkları görülmektedir.

8.1. Duolingo ve Birdbrain Algoritması

Duolingo, “Birdbrain” adlı yapay zeka modeli üzerinden çalışmaktadır. Bu sistem, dünyanın en yaygın dil öğrenme platformlarından biridir. Model, her öğrenci için bir soruyu doğru cevaplama olasılığını hesaplar. Ardından öğrenciye en uygun soruyu sunar. Genellikle %70–%80 başarı olasılığı hedeflenmektedir. Bu durum, bilişim etiğinde bir kara kutu örneği olarak değerlendirilebilir. Öğrenci, karşısına çıkan soruların neden belirli bir zorluk düzeyinde olduğunu bilmez. Ayrıca sistemin kendi performansı hakkında nasıl bir değerlendirme yaptığı da öğrenciye açıklanmaz. Kararlar kapalı bir sistem içinde üretilir. Öğrenci ise sistemin belirlediği yolu pasif biçimde takip eder.

8.2. ALEKS ve Algoritmik Paternalizm

ALEKS sistemi ise Bilgi Uzayı Teorisi’ni temel alan katı bir yönlendirme mekanizmasına sahiptir. Sistem, öğrencinin öğrenmeye hazır olduğu konuları belirler. Algoritma, öğrencinin henüz hazır olmadığına karar verirse ilgili konuya erişimi engeller. Bu durum, algoritmik paternalizmin somut bir örneğidir. Sistem, öğrencinin hata yapma veya kendi sınırlarını zorlama hakkını sınırlar. Çünkü algoritma, öğrenci adına en doğru kararı verdiğini varsayar.

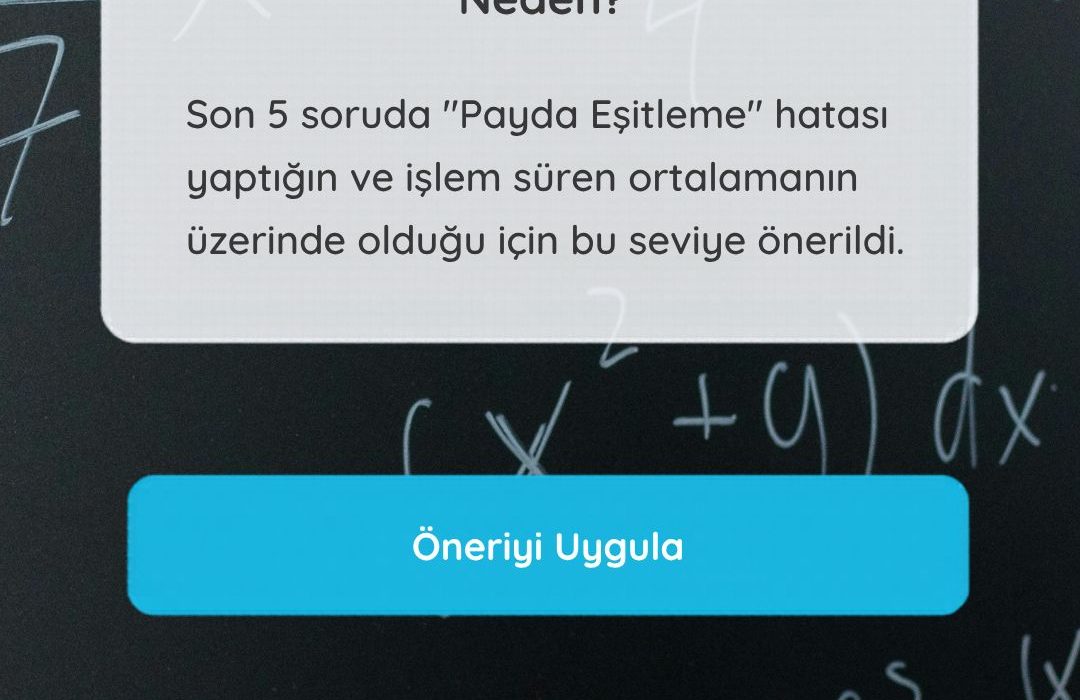

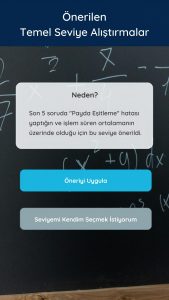

Duolingo benzeri kapalı yönlendirmeler ve ALEKS gibi kısıtlayıcı yapılar, öğrenciyi teknolojinin pasif kullanıcısı hâline getirmektedir. Önerilen “Etik Bildirim ve Onay Modeli” ise farklı bir yaklaşım sunmaktadır. Model, Birdbrain benzeri algoritmaların aldığı kararları “şeffaflık etiketleri” ile görünür kılmayı amaçlamaktadır. Ayrıca ALEKS benzeri kısıtlayıcı yapılar yerine öğrenciye itiraz hakkı tanıyan “özerklik kontrol mekanizmaları” önermektedir. Böylece öğrenme süreci, algoritmanın dayattığı bir yapı olmaktan çıkabilir. Bunun yerine öğrencinin bilinçli kararlarıyla şekillenen daha şeffaf bir süreç oluşturulabilir.

9. Etik Bildirim Ve Onay Modeli

Ele aldığım etik soruna çözüm bulmak için “Etik Bildirim ve Onay Modelini” geliştirdim. Eğitsel yapay zeka sistemlerindeki “kara kutu” sorununu aşmanın yolu, sistemin karar verme mantığını kullanıcıya açan bir tasarım felsefesinden geçer. Kullanıcının yani öğrencinin öğrenim sürecinde sürekli yönlendirilen değil karar verici olması nihai hedeftir. Geliştirilen “Etik Bildirim ve Onay Modeli”, algoritmik şeffaflık ve açıklanabilirlik prensibini temel alarak yapay zekayı karar veren pozisyondan çıkartıp kararlarını açıklayan ve şeffaf davranan bir pozisyona getirmeyi hedefler. Öğrencinin kafasındaki soru işaretlerini giderecek ve öğrenme sürecini anlamlandırmasına büyük bir katkı sağlayacaktır.

Geliştirilen modelin ilk aşaması, öğrencinin karşılaştığı her yapay zeka yönlendirmesinin yanına bir “şeffaflık etiketi” yerleştirmektir. Bu yapı sayesinde öğrenci, sistemin neden belirli bir öneride bulunduğunu saniyeler içinde görebilir. Örneğin; sistem öğrenciye daha zor bir test önerdiğinde, bu kararın “son üç alıştırmadaki %90 başarı oranı” gibi somut verilerle öğrenciye sunulur. Arayüzde sağlanan bu tür bir açıklanabilirlik, kullanıcının algoritma ile kurduğu güven ilişkisini doğrudan güçlendirmektedir (Kizilcec, 2016). Böylece öğrenci, sadece kendisine söyleneni yapan pasif bir kullanıcı olmaktan çıkıp, sistemin mantığını kavrayan bilinçli bir özneye dönüşür.

Şekil 1. Uygulama kapsamında oluşturulan “Etik Bildirim ve Onay Modeli ” Arayüz Protatipi

Kaynak: Beyza Naz Kavuş tarafından oluşturulmuştur

10. Uygulama Süreci

Bu çalışma kapsamında önerilen “Etik Bildirim ve Onay Modeli”, yalnızca kuramsal bir etik yaklaşım değildir. Kullanıcı tarafından deneyimlenebilir etkileşimli bir prototip olarak tasarlanmıştır. Modelin uygulanabilirliğini göstermek amacıyla web tabanlı bir öğrenme sistemi geliştirilmesi planlanmıştır. Sistem, öğrencilerin herhangi bir kurulum işlemi gerçekleştirmeden doğrudan internet tarayıcısı üzerinden erişebileceği şekilde yapılandırılmıştır.

Uygulamanın geliştirilmesinde Python tabanlı Streamlit framework’ünün kullanılması planlanmıştır. Streamlit, hızlı prototipleme ve kullanıcı etkileşimli yapılar geliştirme açısından uygun bir ortam sunduğundan tercih edilmiştir. Böylece kullanıcılar yalnızca bir bağlantı (URL) aracılığıyla sisteme erişebilecek ve önerilen etik modeli eş zamanlı olarak deneyimleyebilecektir.

10.1. Kullanıcı Etkileşimi ve Veri Toplama Süreci

Sistem ilk aşamada öğrenciye kısa bir mini değerlendirme testi sunmaktadır. Bu test, öğrencinin belirli bir konuya ilişkin performansını analiz etmek amacıyla tasarlanmıştır. Süreç boyunca sistem: doğru ve yanlış cevap oranını, soru çözüm sürelerini, tekrar edilen hata sayılarını kaydetmektedir.

Toplanan bu veriler öğrencinin anlık öğrenme profiline dönüştürülmektedir. Böylece sistem, kullanıcının öğrenme düzeyine ilişkin dinamik bir performans modeli oluşturmaktadır.

10.2. Karar Analiz Mekanizması

Toplanan veriler sistem içerisinde yer alan karar analiz mekanizmasına aktarılmaktadır. Bu mekanizma başlangıç aşamasında açıklanabilirliği korumak amacıyla kural tabanlı bir yapı ile tasarlanmıştır.

Sistem belirli performans eşiklerini analiz ederek öğrenciye uygun öğrenme seviyesini belirlemektedir. Örneğin:

-

başarı oranı %50’nin altındaysa orta seviyeye yönlendirme,

-

başarı oranı %80’in üzerindeyse ileri seviyeye geçiş önerisi,

-

çözüm süresi belirlenen eşik değerin üzerindeyse ek tekrar önerisi

sunulmaktadır.

Bu yapı sayesinde sistem, öğrenciye kişiselleştirilmiş öğrenme yönlendirmeleri oluşturabilmektedir.

10.3. Şeffaflık Etiketi Sistemi

Modelin temel bileşenlerinden biri olan “Şeffaflık Etiketi Sistemi”, yapay zekâ kararlarının gerekçelerini kullanıcıya görünür hale getirmektedir.

Sistem tarafından verilen her önerinin yanında: başarı oranı, hata analizi, çözüm süresi, öğrenme performansı gibi veriler kullanıcıya açıklanmaktadır.

Örneğin sistem aşağıdaki biçimde geri bildirim sunmaktadır:

“Son üç etkinlikte başarı oranınız %42 olarak hesaplanmıştır. Bu bağlamda orta seviyede devam etmeniz önerilmektedir.”

Bu yapı sayesinde algoritmik karar verme süreci görünür hale getirilmekte ve kara kutu problemi azaltılmaktadır.

10.4. Özerklik Kontrol Mekanizması

Şeffaflık sağlandıktan sonra sistem öğrenciye karar üzerinde kontrol yetkisi tanımaktadır. Kullanıcı:

-

öneriyi kabul edebilmekte,

-

farklı bir zorluk seviyesi seçebilmekte,

-

sistem kararına itiraz edebilmekte,

-

alternatif öğrenme yolları arasından tercih yapabilmektedir.

Bu mekanizma sayesinde öğrenci yalnızca sistem tarafından yönlendirilen pasif bir kullanıcı olmaktan çıkar. Öğrenme sürecine aktif olarak katılan karar verici bir özne konumuna gelmektedir.

10.5. Alternatif Öğrenme Yolunun Oluşturulması

Öğrencinin yaptığı seçime bağlı olarak sistem öğrenme akışını yeniden düzenlemektedir. Eğer kullanıcı sistem önerisini reddederse farklı seviyede içerikler sunulmaktadır. Bu yapı, öğrenme sürecinin yalnızca algoritmanın yönlendirmesine bağlı kalmamasını sağlamaktadır.

10.6. Web Tabanlı Erişim ve Sınıf İçi Kullanım

Geliştirilen prototipin Streamlit Community Cloud altyapısı üzerinden yayınlanması planlanmaktadır. Böylece uygulama bilgisayar, tablet, mobil cihaz üzerinden herhangi bir kurulum gerektirmeden çalıştırılabilecektir.

Kullanıcılar sisteme yalnızca bir bağlantı aracılığıyla erişebilecektir. Bu sayede uygulamanın sınıf ortamında eş zamanlı ve etkileşimli biçimde deneyimlenmesi mümkün hale gelecektir.

10.7. Teknik ve Etik Tasarım Yaklaşımı

Bu prototipte gerçek zamanlı derin öğrenme modelleri yerine kural tabanlı karar mekanizmaları tercih edilmiştir. Temel nedeni derin öğrenme modellerinin entegresi için hazırlık sürecinin çok daha uzun olmasından kaynaklıdır.

-

açıklanabilir yapay zekâ (XAI),

-

algoritmik şeffaflık,

-

kullanıcı denetimi,

-

öğrenci otonomisi

ilkelerini temel almaktadır.

11. Sonuç

Eğitsel yapay zekâ sistemlerinin sunduğu kişiselleştirme imkânları eğitimde verimliliği artırma potansiyeline sahip olmakla beraber bu sistemlerin birer denetlenemez otorite hâline gelmesi pedagojik bir risktir. Bu makalede tartışılan algoritmik paternalizm teknolojinin bir rehber olmaktan çıkıp öğrencinin akademik sınırlarını tanımlayan kapalı bir “vasisi” haline geldiğini ortaya koyar.

Etik soruna çözüm getiren Etik Bildirim ve Onay Modeli; yapay zekayı bir ‘kara kutu’ olmaktan çıkararak şeffaf ve hesap verebilir bir sistem inşa eder. XAI prensiplerini temel alan bu teknik; öğrencinin neden bu sonuca ulaştığını açıklar ve kararın gerekçesini açıklar. Şeffaflık etiketleri ve özerklik kontrol mekanizmalarıyla öğrenci, algoritmanın pasif takipçisi olmaktan çıkar. Kendi öğrenme sürecinde aktif olarak karar veren bir konuma gelmektedir.

Sonuç olarak, eğitim teknolojileri geliştirilirken etik ilkeler süs niyetinde değil, sistem tasarımına entegre edilmesi gereken zorunlu bir bileşendir. Kendi içinde bir perspektif olarak değerlendirilmelidir. Yapay zekâ eğitimi bir ”hükümdar” değil öğrenci ve öğretmenin denetiminde bir ”yardımcı” olarak konumlandırıldığı kadar gerçek bir gelişim ortağı olmaya devam edebilir. Eğitimde geleceğin sistemleri ise algoritmaların hızına değil, insanın özerkliğine, şeffaflığına bakarak başarı değerlerini elde edecektir.

12. KAYNAKÇA

Morandín-Ahuerma, F. (2023). Ten UNESCO recommendations on the ethics of artificial intelligence. OSF Preprints.https://doi.org/10.31219/osf.io/csyux

Yeung, K. (2017). ‘Hypernudge’: Big Data as a mode of regulation by design. Information, Communication & Society, 20(1), 118–136. https://doi.org/10.1080/1369118X.2016.1186713

Boztepe, C. (2025). Eğitimde Yapay Zekâ Uygulamaları: Fırsatlar, Sınırlılıklar ve Etik Tartışmalar. Dumlupınar Üniversitesi Eğitim Bilimleri Enstitüsü Dergisi, 9(1), 98-121. https://doi.org/10.71272/debder.1706141

Adadi, A. and Berrada, M. (2018) Peeking inside the Black-Box: A Survey on Explainable Artificial Intelligence (XAI). IEEE Access, 6, 52138-52160.

https://doi.org/10.1109/ACCESS.2018.2870052

Varol, N. (2025). Eğitimde yapay zekâ ve etik: Bir alanyazın taraması. Okul Yönetimi, 5(1), 117-125. https://izlik.org/JA87US93SW

Kizilcec, R. F. (2016). How much information?: Effects of transparency on trust in an algorithmic interface. Proceedings of the 2016 CHI Conference on Human Factors in Computing Systems, 2390–2395. https://doi.org/10.1145/2858036.2858402

Zhang, A., Lipton, Z. C., Li, M., & Smola, A. J. (2023). Dive into deep learning. Cambridge University Press. 10.48550/arXiv.2106.11342

![]()

Bu eser Beyza Naz Kavuş tarafından Creative Commons Atıf-AynıLisanslaPaylaş 4.0 Uluslararası Lisansı ile lisanslanmıştır.

13. Özgünlük Raporu

Araştırmanın özgünlük kontrolü, 11.05.2026 tarihinde plagiarismdetector adlı platform aracılığıyla gerçekleştirilmiştir. Yapılan analiz sonucunda çalışmanın %98 oranında özgün içerik içerdiği, %2 oranında birebir eşleşme bulunduğu ve kısmi eşleşme oranının %0 olduğu belirlenmiştir.

14. Yapay Zeka Kontrol Raporu

Çalışmanın yapay zeka içerik kontrolü, 11.05.2026 tarihinde GPTZero adlı platform aracılığıyla gerçekleştirilmiştir. Yapılan analiz sonucunda metnin yapay zeka tarafından üretilme olasılığı %0 olarak saptanmış ve içeriğin tamamen insan tarafından oluşturulduğu belirlenmiştir.

Marmara Üniversitesi Bilgisayar ve Öğretim Teknolojileri Eğitimi son sınıf öğrencisiyim. Aynı zamanda İstanbul Üniversitesi AUZEF Grafik Tasarım programında öğrenim görmekteyim. Grafik tasarım, eğitim teknolojileri ve öğretim tasarımı alanlarına ilgi duyuyor; bu alanlarda kendimi geliştirmeye ve projeler üretmeye odaklanıyorum. Akademik birikimimi pratik deneyimlerle destekleme sürecinde, Bilişim Teknolojileri öğretmenliği stajıma aktif olarak devam etmekteyim. Bu süreç, öğrencilerin dijital yetkinliklerini geliştirme ve öğretim tasarımı ilkelerini sınıf ortamında uygulama konusunda bana saha tecrübesi kazandırmaktadır. Ayrıca geçmişte gerçekleştirdiğim İnsan Kaynakları stajım, kurumsal iletişim, organizasyonel yapı ve profesyonel süreç yönetimi konularında bakış açımı genişletmiştir.

Grafik tasarım disiplininin sunduğu görsel iletişim gücünü eğitim teknolojileriyle entegre ederek etkili ve yenilikçi öğrenme deneyimleri tasarlamaya odaklanıyorum. Bunun yanında veri mühendisliği alanında da kendimi geliştirmekteyim. İstanbul Data Science Academy ve Google Cloud tarafından düzenlenen Boostcamp kapsamında laboratuvar çalışmalarını tamamladım; ayrıca Google Türkiye ofisinde sektör profesyonelleriyle tanışma ve network edinme fırsatı buldum. Kendimi sürekli geliştirmeye açık, araştırmacı ve proje odaklı bir aday olarak; sanal gerçeklik destekli kodlama eğitimi için bir öğretim tasarımı geliştirmekteyim. Teorik bilgimi staj tecrübelerim, tasarım becerilerim, veri odaklı bakış açım ve disiplinler arası yetkinliklerimle harmanlayarak sektörün dinamik ihtiyaçlarına yaratıcı, uygulanabilir ve öğrenci merkezli yanıtlar sunmaya hazırım.